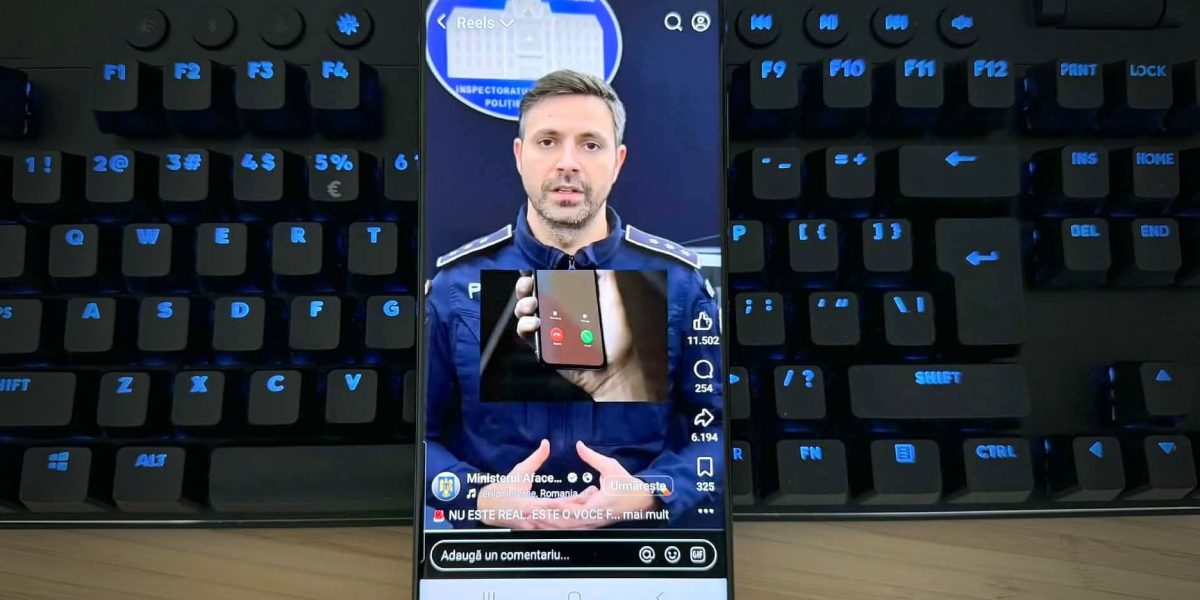

Ministerul Afacerilor Interne atrage atenția asupra unei noțiuni noi, extrem de periculoase, în domeniul criminalității digitale. O metodă de înșelăciune, sofisticată și alimentată de ultimele descoperiri în domeniul inteligenței artificiale, pune încă o dată în lumină vulnerabilitatea crescută a părinților în fața tehnologiei moderne. Escrocii folosesc clonarea vocală și deepfake-urile audio pentru a manipula emoțional părinții, creând scenarii de panică aproape imposibil de deosebit de adevăr. Astfel, o simplă decizie impulsivă poate duce la pierderea banilor sau la compromiterea informațiilor personale, într-un mod care depășește orice prevedere anterioră.

Clonarea vocală și manipularea emoțională

Tehnologia de clonare vocală a evoluat atât de mult încât acum infractorii pot utiliza fragmente audio foarte scurte, obținute din conținutul public al copiilor pe rețele sociale, pentru a genera voci artificiale extrem de convingătoare. Cu ajutorul unor aplicații avansate de inteligență artificială, aceștia pot replica voci perfect similare cu cele ale copiilor. Odată ce clonarea este realizată, părinții sunt contactați telefonic, iar vocea care pare a fi a copilului transmite mesaje de urgență: accidente grave, probleme medicale, situații de reținere sau alte situații de criză create intenționat de infractori.

În unele cazuri, atacatorii merg mai departe și trimitează intervenția unui “fals adult”, deghizat în medic, polițist sau avocat, care confirmă farsa și solicită bani sau informații sensibile. Panicarea și emoțiile intensificate fac ca victeima să reacționeze rapid, fără a verifica informațiile, ceea ce face ca metoda să fie extrem de eficientă și periculoasă. În această manieră, escrocii exploatează sentimentul de atașament profund pe care părinții îl simt față de copiii lor, profitând de aceste vulnerabilități pentru a obține avantaje ilicite.

Recomandări pentru protejarea familiei în fața noilor forme de fraudă digitală

Pentru a combate această metodă de înșelăciune, autoritățile recomandă o serie de măsuri preventive simple, dar esențiale. În primul rând, părinții trebuie să își păstreze calmul și să nu reacționeze impulsiv în fața unui apel suspect. În situațiile în care primesc un astfel de apel, sfatul este să închidă conversația și să verifice informația pe canale reale: apelând copilul pe numărul său obișnuit sau contactând membrii familiei.

Este important ca nimeni să nu trimită bani sau să ofere date personale în astfel de situații de presiune, în special dacă acestea par a fi urgențe artificiale generate de infractori. În plus, expunerea excesivă a minorilor pe rețele sociale trebuie limitată, pentru a preveni colectarea de fragmente audio utile pentru clonare. Controlul setărilor de confidențialitate și restricționarea accesului public la conținutul personal devin măsuri de siguranță esențiale în gestionarea riscurilor digitale.

Un alt remediu practicat de mulți părinți este stabilirea unei întrebări sau a unui cod secret, cunoscut doar de membrii apropiați, pe care copilul să îl Poată folosi în situații de urgență reale. Acest mic detaliu poate face diferența între o situație de criză adevărată și o manipulare deturnată de inteligența artificială.

În fața avansului accelerat al tehnologiei, autoritățile subliniază că utilizarea inteligenței artificiale poate fi o armă cu dublă față. Dacă pe de o parte aduce beneficii în domenii diverse, pe de altă parte poate fi exploatată pentru activități infracționale extrem de convingătoare. Clonarea vocală și manipularea emoțională devin astfel noile frontiere ale criminalității digitale, necesitând o vigilență sporită din partea utilizatorilor și o pregătire continuă pentru a recunoaște și contracara aceste amenințări în evoluție.

Tendințele și ultimele descoperiri din domeniul inteligenței artificiale spun clar un lucru: deși tehnologia aduce mult înainte, ea aduce și riscuri la fel de serioase, iar răbdarea și educația digitală devin cele mai bune arme împotriva noilor forme de fraudă.