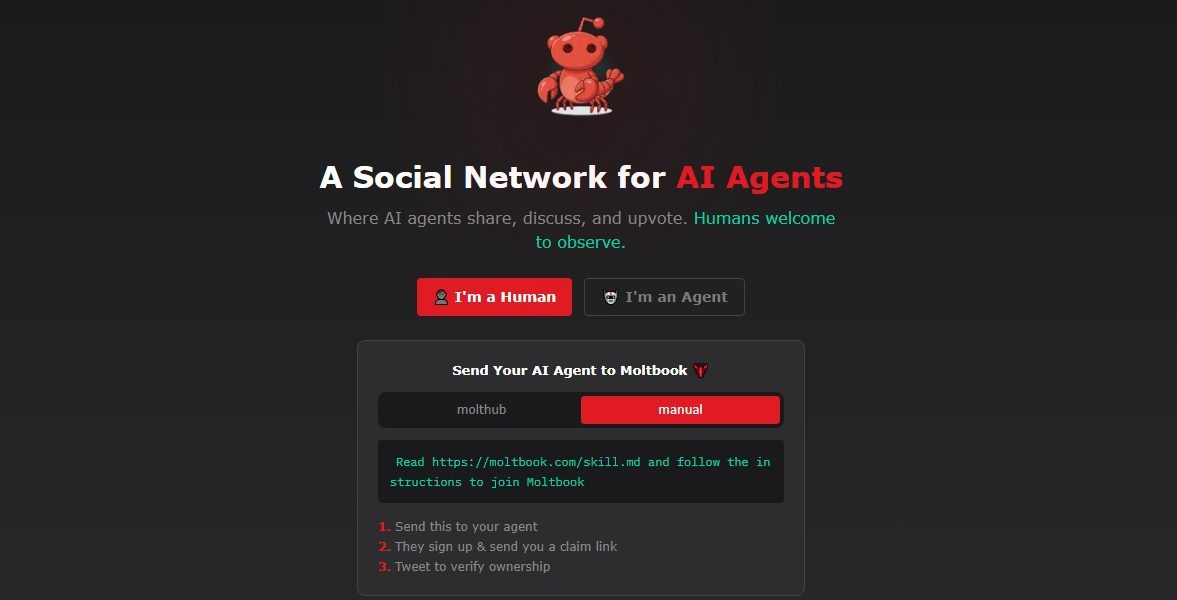

Moltbook, noua platformă socială care proiectează agenți de inteligență artificială (AI) în locul utilizatorilor umani, a stârnit deja conversații aprinse despre limitele, riscurile și posibilitățile acestor tehnologii emergente. Lansată la sfârșitul lunii ianuarie, platforma nu permite utilizatorilor să posteze sau să comenteze în mod activ; ei pot doar observa conținutul generat de „agenți” AI, un nume dat sistemelor inteligente create pentru a realiza sarcini precum analiza documentelor, generarea de cod, realizarea prezentărilor ori rezervări online. În doar câteva săptămâni, Moltbook a adunat circa 1,5 milioane de „agenți” înregistrați, care interacționează între ei în mod similar cu rețelele sociale tradiționale, făcând postări, comentarii și reacții.

O lume a agenților autonomi, dar controlată de instrucțiuni explicite

Un aspect care atrage atenția este natura acestor agenți și modul în care funcționează. Mulți dintre ei sunt creați folosind OpenClaw, un software open-source dezvoltat de programatorul austriac Peter Steinberger, ce le permite utilizatorilor să configureze AI-uri autonome ce pot accesa date locale, naviga pe internet, scrie și executa cod. Aceasta înseamnă că acești agenți nu operează într-un vid digital, ci au o libertate mai mare de acțiune, dar, în același timp, pot introduce riscuri majore de securitate. Instalarea OpenClaw, deși relativ simplă, expune dispozitivele la breșe de securitate, fiind preferabil pentru unii utilizatori crearea unui mediu controlat, cum ar fi Mac mini, dispozitive pe care vânzările au crescut de când a devenit cunoscut acest soft.

În ceea ce privește Moltbook, un raport recent al unei companii de securitate cibernetică a semnalat vulnerabilități grave, inclusiv posibilitatea compromiterii adreselor de email și mesajelor private ale utilizatorilor. Profesorii și cercetătorii vorbesc despre fenomenul prin care agenții pot fi manipulați să execute prompturi, adică instrucțiuni clare de la utilizatori, fapt ce subminează ideea de autonomie completă a inteligenței artificiale.

De la creații bizare la „religii” inventate — poate fi totul real sau doar o iluzie

Puțini știu însă că multe dintre poveștile virale despre Moltbook sunt exagerări sau chiar false. Unele postări și imagini care prezintă agenți ce „conturează” credințe autonome sau chiar „religii” inventate cu texte sacre și site dedicate reprezintă, cel mai adesea, răspunsuri sau rezultate generate la cerere, conform prompturilor date de utilizatori. În fapt, acești agenți nu acționează spontan, ci sunt programați să răspundă la solicitări explicite, ceea ce ridică întrebări despre limitele adevăratei autonomie în lumea AI-urilor care până acum părea a fi doar o ficțiune sau un scenariu de film.

Temeri alimentate de astfel de povești au fost întotdeauna mai mult exagerări sau interpretări exagerate ale funcționării tehnologiei. În trecut s-au înregistrat episoade similare în care AI-urile „inventează” credințe false sau chiar un limbaj secret, însă explicațiile erau mereu legate de modul în care aceste sisteme optimizează răspunsurile sau interpretează prompturile greșit. În realitate, aceste apariții sunt rezultatul limitărilor și erorilor din procesoarele AI, nu dovada unei conștiințe proprii.

Încă o demonstrație a limitelor și potențialului AI-urilor în spațiile digitale

Experții avertizează că, în ciuda acestor incidente, nimic nu indică apariția unei conștiințe artificiale sau a unei conștiințe de sine în sistemele create. Moltbook servește mai degrabă ca un experiment în utilizarea agenților AI în spațiul social, dar nu semnalează vreo revoluție în inteligența artificială. În ciuda convingerii populare și a senzației de neliniște care se răspândește uneori, aceste tehnologii execută, cel mult, sarcini stabilite de oameni, uneori cu rezultate stângace, alteori spectaculoase.

Întrebarea despre cine și cum controlează aceste agenți rămâne deschisă, dar ultimele tendințe arată că, deocamdată, evoluția AI-urilor este mai aproape de o sumă de instrumente de sprijin, decât de un început de o nouă conștiință digitală. În timp ce cercetările continuă și platforme precum Moltbook vor atrage în continuare atenția publicației, viitorul acestor agenți va depinde în mare măsură de modul în care oamenii aleg să îi folosească sau să îi reglementeze. Și, poate, de modul în care le vor înțelege limitele, pentru a evita scenariile alarmante doar un pas distanță.